Nicolas Kayser-Bril

Reporter

Foto: Julia Bornkessel, CC BY 4.0

Französisch, Englisch, Deutsch

nkb@

PGP Public Key

https://social.nkb.fr/@

Nicolas arbeitet für AlgorithmWatch als Reporter. Nach einem Studium der Wirtschaftswissenschaften entwickelte er 2009 interaktive, datengesteuerte Anwendungen für Le Monde. Anschließend baute er das Datenjournalismus-Team bei OWNI auf, bevor er von 2011 bis 2017 Journalism++ mitbegründete und leitete. Nicolas hält regelmäßig Vorträge auf internationalen Konferenzen, unterrichtet an französischen Journalismusschulen und leitet Schulungen für Redaktionen. Er ist einer der Hauptverfasser des Datajournalism Handbook.

Beiträge für AlgorithmWatch

Das Jahr, in dem wir auf Taten warteten: 2023 im Rückblick

AlgorithmWatch begrüßt seine ersten Stipendiat*innen

War es das Jahr, in dem die Regulierung automatisierter Systeme ihren Anfang nahm? – 2022 im Rückblick

Über Algorithmen in unserer Gesellschaft schreiben: AlgorithmWatch vergibt 5 Stipendien

Meta angeklagt: Algorithmen als Nährboden für Betrug?

Datensätze ohne Verfallsdatum: Wie im Namen der Wissenschaft Grundrechte verletzt werden

Ein neuer europäischer Newsroom untersucht automatisierte Systeme

Das Jahr, in dem automatisierte Systeme kein Teil der Lösung waren – 2021 im Rückblick

Süddeutsche veröffentlicht Ergebnisse unseres Instagram-Forschungsprojekts zur Bundestagswahl

LinkedIn: Bewerber·innen aus dem Ausland „nicht geeignet“

Wie Big Tech europäische Politik, Presse und Forschung umgarnt und bedrängt

In Berlin verleiten Google Maps und TomTom Autofahrer·innen zu Gesetzesverstößen

Die Insta-Mafia: Kleinkriminelle melden Nutzer·innen massenhaft für Profit

Das Jahr, in dem die Algorithmen der Quarantäne entkamen: 2020 im Rückblick

Automatisierte Diskriminierung: Facebook verwendet grobe Stereotypen, um die Anzeigenschaltung zu optimieren

Instagram-Algorithmus: Wer gesehen werden will, muss Haut zeigen

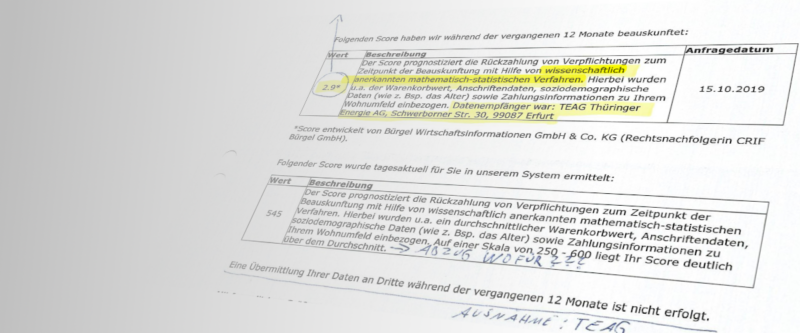

Wie ein Schreibfehler die Kreditwürdigkeit senken kann

Gemeinwesen im Zeichen der Automatisierung: 9 Vorhersagen für 2020

Der Amazonas-Brand und die CO2-Bilanz von Amazon: 2019 im Rückblick

AlgorithmWatch deckt auf: In mindestens zehn EU-Ländern nutzt die Polizei automatisierte Gesichtserkennung

Palantir, die Datenkrake aus dem Umfeld der Trump-Administration, zieht es nach Europa

Facebook ermöglicht automatisierte Betrugsmaschen, scheitert aber bei deren automatisierter Bekämpfung

UN-Sonderberichterstatter prangert “menschenrechtsfreie Zonen” an